Como o Webb envia suas imagens de cem megapixels a um milhão de quilômetros de volta à Terra

A NASA acaba de revelar o primeiro conjunto de imagens do Telescópio Espacial James Webb, desde um impressionante campo profundo de galáxias até uma caracterização minuciosa da atmosfera de um exoplaneta distante. Mas como uma espaçonave a um milhão de quilômetros de distância leva dezenas de gigabytes de dados de volta à Terra?

Primeiro vamos falar sobre as imagens em si. Estes não são apenas JPEGs de fábrica - e o Webb não é apenas uma câmera comum.

Como qualquer instrumento científico, o Webb captura e envia para casa resmas de dados brutos de seus instrumentos, dois sensores de infravermelho próximo e médio de alta sensibilidade e uma série de acessórios que podem especializar-se para espectroscopia, coronografia e outras tarefas, conforme necessário.

Tomemos como exemplo uma das primeiras imagens divulgadas recentemente com uma comparação direta.

Corrida de megapixels

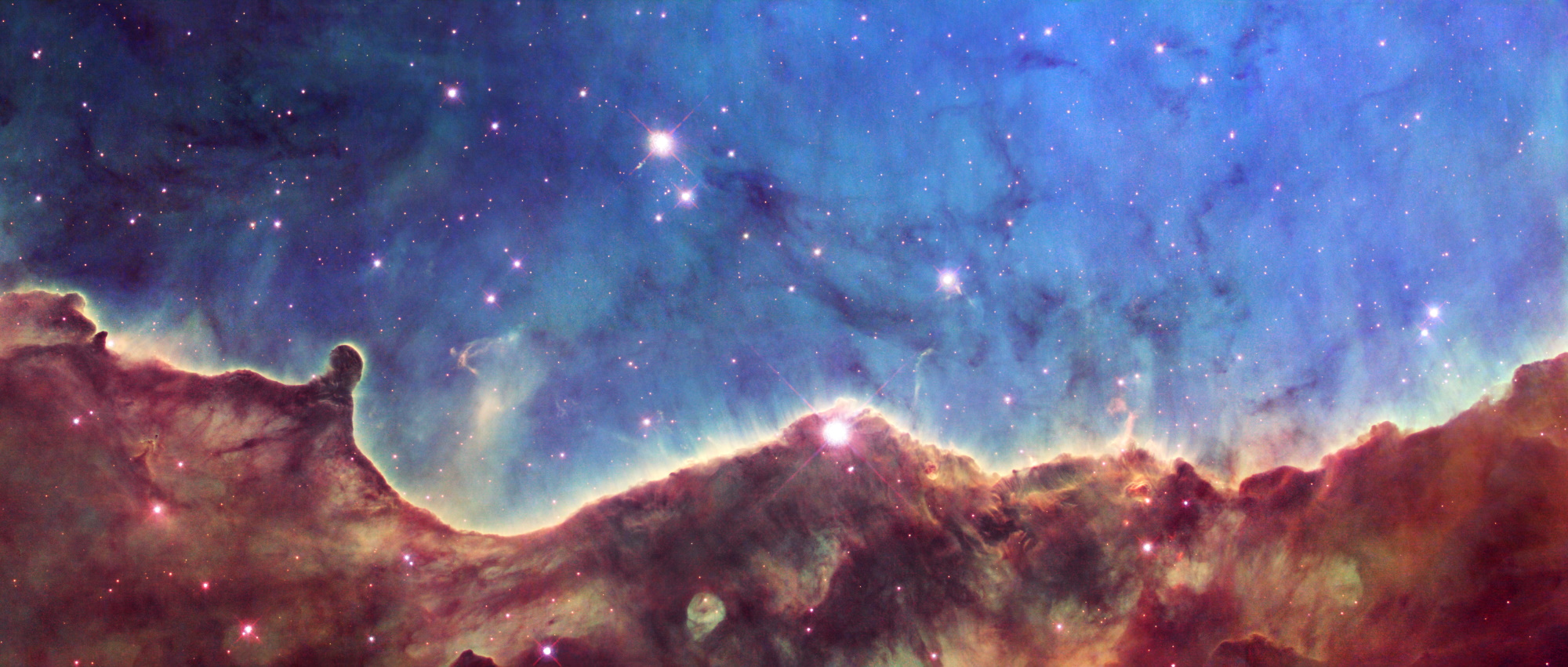

O Hubble, que é mais comparável a um telescópio tradicional de luz visível, tirou esta imagem da Nebulosa Carina em 2008:

Créditos da Imagem: Equipe de Patrimônio da NASA/ESA/Hubble

Claro que esta é uma imagem incrível. Mas o Hubble é mais comparável a um telescópio tradicional de luz visível e, mais importante, foi lançado em 1990. A tecnologia mudou um pouco desde então!

Aqui está a versão do Webb dessa mesma região:

Créditos da Imagem: NASA, ESA, CSA, STScI

É claro para qualquer espectador que a versão Webb tem muito mais detalhes, mesmo olhando para essas versões pequenas. A textura viscosa da nebulosa se resolve em intrincadas formações de nuvens e wisps, e mais estrelas e presumivelmente galáxias são claras e visíveis. (Embora observemos aqui que a imagem do Hubble tem seus próprios encantos.)

Vamos apenas ampliar uma região para enfatizar o nível de detalhe que está sendo capturado, apenas à esquerda e para cima a partir do centro:

Créditos da Imagem: NASA, ESA, CSA, STScI

Extraordinário, né? Mas esse detalhe tem um custo: dados!

A imagem do Hubble tem cerca de 23,5 megapixels, pesando 32 megabytes descompactados. A imagem Webb (conforme disponibilizado após o manuseio) é de 123 megabytes e aproximadamente 137 megabytes. Isso é mais de cinco vezes os dados, mas nem isso conta toda a história. As especificações do Webb fazem com que ele envie dados de volta a 25 vezes a taxa de transferência do Hubble - não apenas imagens maiores, mas mais delas… de 3.000 vezes mais longe.

Chamadas de longa distância

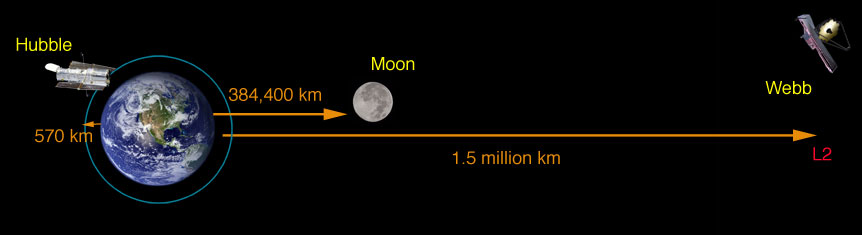

O Hubble está em uma órbita baixa da Terra, cerca de 340 milhas acima da superfície. Isso significa que a comunicação com ele é realmente bastante simples - seu telefone recebe de forma confiável sinais de satélites GPS muito mais distantes, e é uma brincadeira de criança para um cientista da NASA passar informações de um lado para o outro para um satélite em uma órbita tão próxima.

O JWST, por outro lado, está no segundo ponto de Lagrange, ou L2, a cerca de um milhão de quilômetros da Terra, diretamente longe do Sol. Isso é quatro vezes mais longe do que a Lua chega e uma proposta muito mais difícil em alguns aspectos. Aqui está uma animação da NASA mostrando como essa órbita se parece:

Felizmente este tipo de comunicação está longe de ser inédito; Enviamos e recebemos grandes quantidades de dados de muito mais longe. E sabemos exatamente onde o Webb e a Terra estarão a qualquer momento, então, embora não seja trivial, trata-se apenas de escolher as ferramentas certas para o trabalho e fazer um agendamento muito cuidadoso.

Desde o início, o Webb foi projetado para transmitir através da banda Ka de ondas de rádio, na faixa de 25,9 giga-hertz, bem nas faixas usadas para outras comunicações via satélite. (A Starlink, por exemplo, também usa Ka, assim como outros ao redor desse território.)

Essa antena de rádio principal é capaz de enviar cerca de 28 megabits por segundo, o que é comparável às velocidades de banda larga doméstica — se o sinal do roteador levou cerca de cinco segundos para percorrer um milhão de quilômetros de vácuo para chegar ao seu laptop.

Meramente ilustrativo para uma noção das distâncias – os objetos não são para escalar, obviamente. Créditos da Imagem: Equipe de Patrimônio da NASA/ESA/Hubble

Isso lhe dá cerca de 57 gigabytes de capacidade de downlink por dia. Há uma segunda antena funcionando na banda S inferior - surpreendentemente, a mesma banda usada para Bluetooth, Wi-Fi e abridores de porta de garagem - reservada para coisas de baixa largura de banda, como atualizações de software, telemetria e verificações de saúde. Se você está interessado nos detalhes, o IEEE Spectrum tem um ótimo artigo que entra em mais detalhes sobre isso.

No entanto, este não é apenas um fluxo constante, já que é claro que a Terra gira e outros eventos podem interceder. Mas como eles estão lidando com variáveis mais conhecidas, a equipe do Webb planeja seus tempos de contato com quatro ou cinco meses de antecedência, transmitindo os dados por meio da Deep Space Network. O Webb pode estar capturando dados e enviando-os no mesmo dia, mas tanto a captura quanto a transmissão foram planejadas muito, muito antes.

Curiosamente, o Webb tem apenas cerca de 68 gigabytes de espaço de armazenamento internamente, o que você pensaria que deixaria as pessoas nervosas se ele pudesse enviar 57 - mas há oportunidades mais do que suficientes para descarregar esses dados para que ele nunca receba a temida mensagem de “unidade cheia”.

Mas o que você vê no final – mesmo aquela grande imagem TIFF de 123 megabytes não compactada – não é o que o satélite vê. Na verdade, ele nem percebe a cor como a entendemos.

“Permitindo que os dados sejam mostrados com cores”

Os dados que entram nos sensores estão no infravermelho, que está além da estreita faixa de cores que os humanos podem ver. Usamos muitos métodos para ver fora dessa faixa, é claro, por exemplo, raios-X, que capturamos e visualizamos de uma maneira que podemos ver fazendo com que eles atinjam um filme ou sensor digital calibrado para detectá-los. É o mesmo para o Webb.

“O telescópio não é realmente uma câmera point-and-shoot. Então não é como se a gente pudesse tirar uma foto e lá está, né? É um instrumento científico. Então, ele foi projetado em primeiro lugar para produzir resultados científicos”, explicou Joe DePasquale, do Space Telescope Science Institute, em um podcast da Nasa.

Créditos da Imagem: Equipe de Patrimônio da NASA/ESA/Hubble

O que ele detecta não são realmente dados que os humanos podem analisar, muito menos perceber diretamente. Por um lado, o intervalo dinâmico está fora dos gráficos – isso significa a diferença de magnitude entre os pontos mais escuros e mais claros. Não há basicamente nada mais escuro do que o vazio infinito do espaço e não muito mais brilhante do que um sol explodindo. Mas se você tem uma imagem que inclui ambos, tirada ao longo de um período de horas, você acaba com enormes deltas entre o escuro e o claro nos dados.

Agora, nossos olhos e cérebros têm um alcance dinâmico muito bom, mas isso os tira da água – e, mais importante, não há uma maneira real de mostrar isso.

“Basicamente parece uma imagem preta com algumas manchas brancas, porque há um alcance dinâmico enorme”, disse DePasquale. “Temos que fazer algo chamado esticar os dados, que é pegar os valores de pixel e meio que reposicioná-los, basicamente, para que você possa ver todos os detalhes que estão lá.”

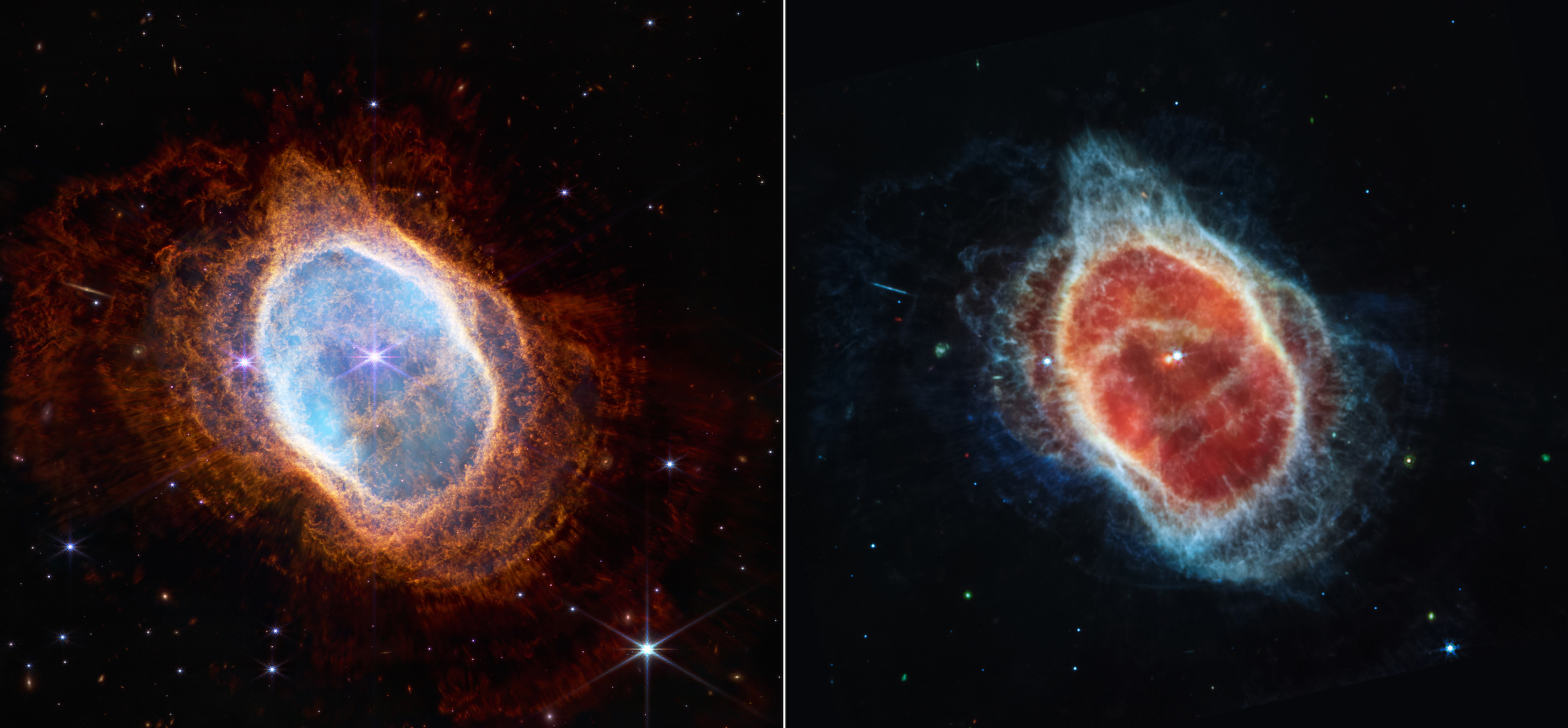

Antes de objetar de qualquer forma, primeiro, saiba-se que é basicamente assim que todas as imagens são criadas – uma seleção do espectro é recortada e adaptada para visualização por nosso sistema visual muito capaz, mas também limitado. Como não podemos ver no infravermelho e não há equivalente de vermelho, azul e verde nessas frequências, os analistas de imagem têm que fazer um trabalho complicado que combine o uso objetivo dos dados com a compreensão subjetiva da percepção e, de fato, da beleza. As cores podem corresponder a comprimentos de onda em uma ordem semelhante, ou talvez ser divididas até realçar mais logicamente regiões que “parecem” semelhantes, mas emitem radiação muito diferente.

“Nós gostamos de, você sabe, a comunidade de imagens em astrofotografia gostar de se referir a esse processo como ‘cor representativa’, em vez do que costumava ser chamado, ainda são muitas pessoas chamam de ‘imagens de cores falsas’. Eu não gosto do termo ‘falsa cor’, porque ele tem essa conotação de que estamos fingindo isso, ou é, você sabe, isso não é realmente o que parece; os dados são os dados. Não vamos lá e aplicamos, como pintar cor na imagem. Estamos respeitando os dados do começo ao fim. E estamos permitindo que os dados apareçam com cores.”

Se você olhar para a imagem acima, as duas visões da nebulosa, considere que elas foram tiradas do mesmo ângulo, mais ou menos ao mesmo tempo, mas usando instrumentos diferentes que capturam diferentes segmentos do espectro IR. Embora, em última análise, ambos devam ser mostrados em RGB, os diferentes objetos e recursos encontrados pela inspeção de comprimentos de onda mais altos podem ser tornados visíveis por esse tipo de método criativo, mas cientificamente rigoroso de atribuição de cores.

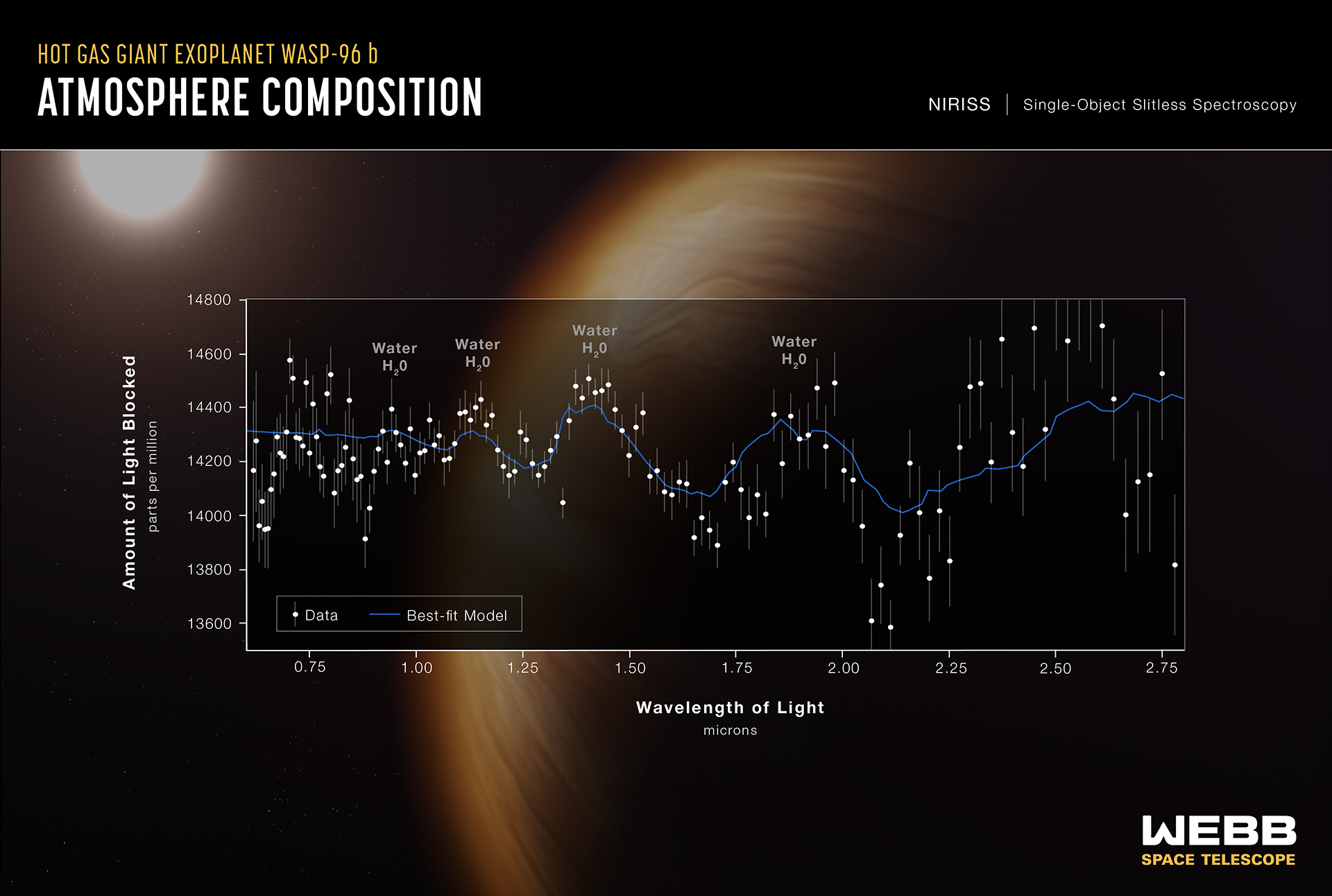

E, claro, quando os dados são mais úteis como dados do que como representação visual, há maneiras ainda mais abstratas de olhar para eles.

Créditos da Imagem: NASA, ESA, CSA, STScI

Uma imagem de um exoplaneta distante pode mostrar nada além de um ponto, mas um espectrograma mostra detalhes reveladores de sua atmosfera, como você pode ver neste exemplo imediatamente acima.

Coletar, transmitir, receber, analisar e apresentar os dados de algo como o Webb é uma tarefa complexa, mas à qual centenas de pesquisadores estão se dedicando alegre e animadamente agora que ele está funcionando. Antecipe maneiras ainda mais criativas e fascinantes de exibir essas informações – com o JWST apenas começando sua missão a um milhão de milhas de distância, temos muito o que esperar.